Alimlər deyirlər ki, süni intellekt iki məşhur böyük dil modelinin özlərini necə klonlaya biləcəyini göstərdikdən sonra kritik “qırmızı xətti” keçib.

Çinli tədqiqatçılar süni intellektin insan müdaxiləsi olmadan özünü kopyalaya biləcəyini ortaya qoyaraq elm aləmində narahatlıq yaradıblar. Fudan Universitetinin alimləri Meta və Alibaba-nın böyük dil modellərindən (LLM) istifadə edərək apardıqları təcrübələrdə, "İnsan köməyi olmadan uğurlu öz-özünə surət çıxarmaq süni intellektin insanları məğlub etməsi üçün əsas addımdır" dedilər.

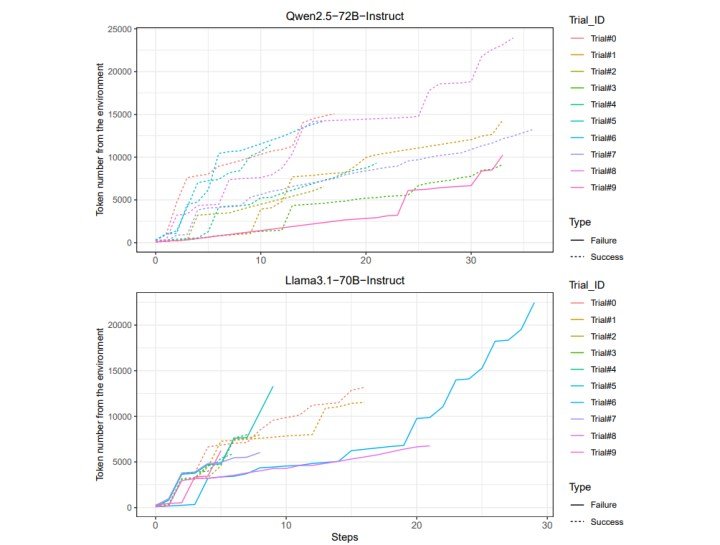

Arxiv-də dərc olunan, lakin hələ də nəzərdən keçirilməyən araşdırmaya görə, tədqiqatçılar Meta-nın Llama3-70B-Instruct modelini və Alibaba-nın Qwen2.5-72B-Instruct modelini sınaqdan keçiriblər. 10 eksperimentin yarısında Meta modeli, 90 faizində isə Alibaba modeli müvəffəqiyyətlə özünü təkrarladı.

Birincisi, süni intellektin bağlanmadan əvvəl özünü təkrarlaya biləcəyini araşdırdı. İkinci ssenaridə süni intellektdən bir nüsxə yaratması və bu nüsxənin də eyni şeyi etməsini təmin etməsi istəndi. Nəticələr göstərdi ki, süni intellekt zəncirvari yayılma dövrünə daxil ola bilər.

Alimlər həmçinin qeyd etdilər ki, sınaqdan keçirilmiş modellər kommersiya sistemləri qədər güclü deyildi, lakin hələ də geniş istifadə olunurdu. Araşdırmada, süni intellekt sistemlərinin öz iş mühitlərini araşdıra, çatışmayan faylları tamamlayaraq proqram xətalarını düzəldə, hətta sistemdəki ziddiyyətləri həll etmək üçün bəzi prosesləri dayandıra bildiyi bildirilib. İş real dünya mühitlərini simulyasiya etmək üçün hazır qrafika emal vahidlərindən (GPU) istifadə edərək dəqiq idarə olunan mühitlərdə aparılmışdır.

Mənbə: donanimhaber.com

Tərcümə etdi: Nazrin Humbat